复旦大学电磁波信息科学教育部重点实验室徐丰教授课题组提出一种利用人工智能将SAR(Synthetic Aperture Radar,合成孔径雷达)图像和更加直观的光学图像之间进行相互翻译的方法,可以促进大量的SAR遥感图像存档的应用,具有推广应用前景。

SAR具有在全天时、全天候条件下高分辨率成像的能力。作为一种先进的空间遥感技术,它在地球科学、天气变化、环境系统监测、海洋资源利用、行星探测等方面得到了广泛的应用。尽管SAR成像技术发展迅速,但SAR图像的解译仍然存在挑战,并且随着轨道上众多雷达卫星每天都在获取大量的SAR数据,解译变得越来越迫切。由于其独特的成像机制和复杂的电磁波散射机理,SAR表现出与光学图像非常不同的成像特征,人类的视觉系统适用于光学图像的解译,却很难解译SAR图像。虽然SAR图像包含丰富的有关目标和场景信息,例如几何结构和材料属性,但它们只能由训练有素的专家解译,这已成为利用现有SAR图像和进一步推广SAR应用的主要障碍。

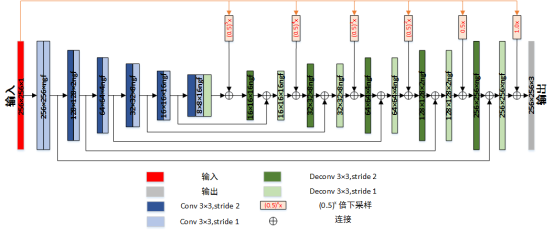

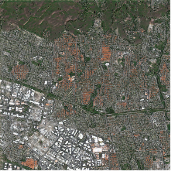

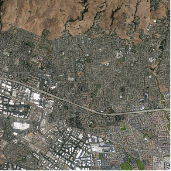

自2014年以来,基于深度学习的方法已逐渐被应用于SAR图像的解译。相比于计算机领域中被广泛研究的两个光学图像域之间转换的图像翻译,SAR和光学图像之间的转换问题更加复杂,需要涉及两种传感模式截然不同的数据。徐丰教授课题组设计了新型的级联残差生成对抗网络(Cascaded-Residual Adversarial Networks, CRAN)专门用于SAR图像翻译。CRAN翻译网络基于经典的翻译网络U-Net,在自编码器中添加了编码器到解码器的直连链路,解决了信息瓶颈造成的信息损失。如图1所示,课题组首次将输入图像下采样到不同的尺度,作为残差模块连接到解码器中,避免了梯度消失现象的产生。如图2所示,分别展示了乡村和城市两个地区的全极化Pauli图像转换的光学图像结果,与真值类似,地物轮廓分明,色彩丰富。

图1 CRAN网络结构

原始SAR图像 翻译的光学图像 光学图像真值

图2 CRAN网络翻译结果

该工作可以被用于SAR图像解译,任何没有雷达背景知识的人借助该工具轻易看懂SAR图像;也为其他的一些潜在的应用,比如光学和SAR图像的数据融合,提供了可能性。

地址:上海市淞沪路2005号复旦大学交叉二号楼B6001室 200438

地址:上海市淞沪路2005号复旦大学交叉二号楼B6001室 200438

电话:021-31242602

电话:021-31242602  Email:cse@fudan.edu.cn

Email:cse@fudan.edu.cn

版权所有: 2019年 复旦大学通信科学与工程系

关注微信号